Mijn Samsung Galaxy S9 heeft 64GB intern geheugen en de mogelijkheid om via een microSD kaartje de interne opslag uit te breiden. Door de jaren heen heeft zich op het toestel een aardige hoeveelheid foto’s en filmpjes verzameld. Want tja, al doen we tegenwoordig “alles in de cloud” er zijn genoeg moment (bv als ik op vakantie ben) waarop ik lekker […]

Hardware

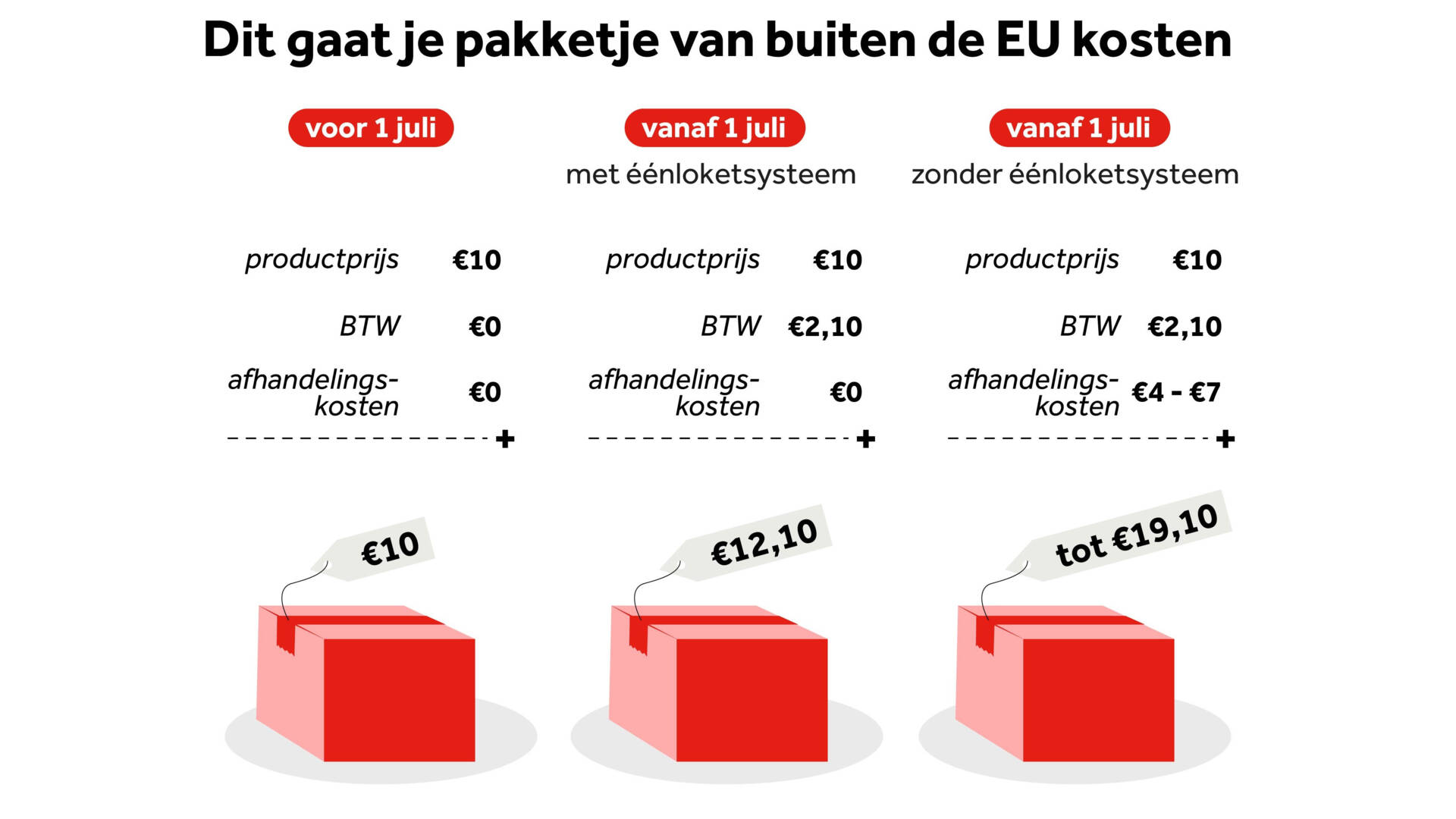

Na 1 juli ook BTW op goedkope producten.

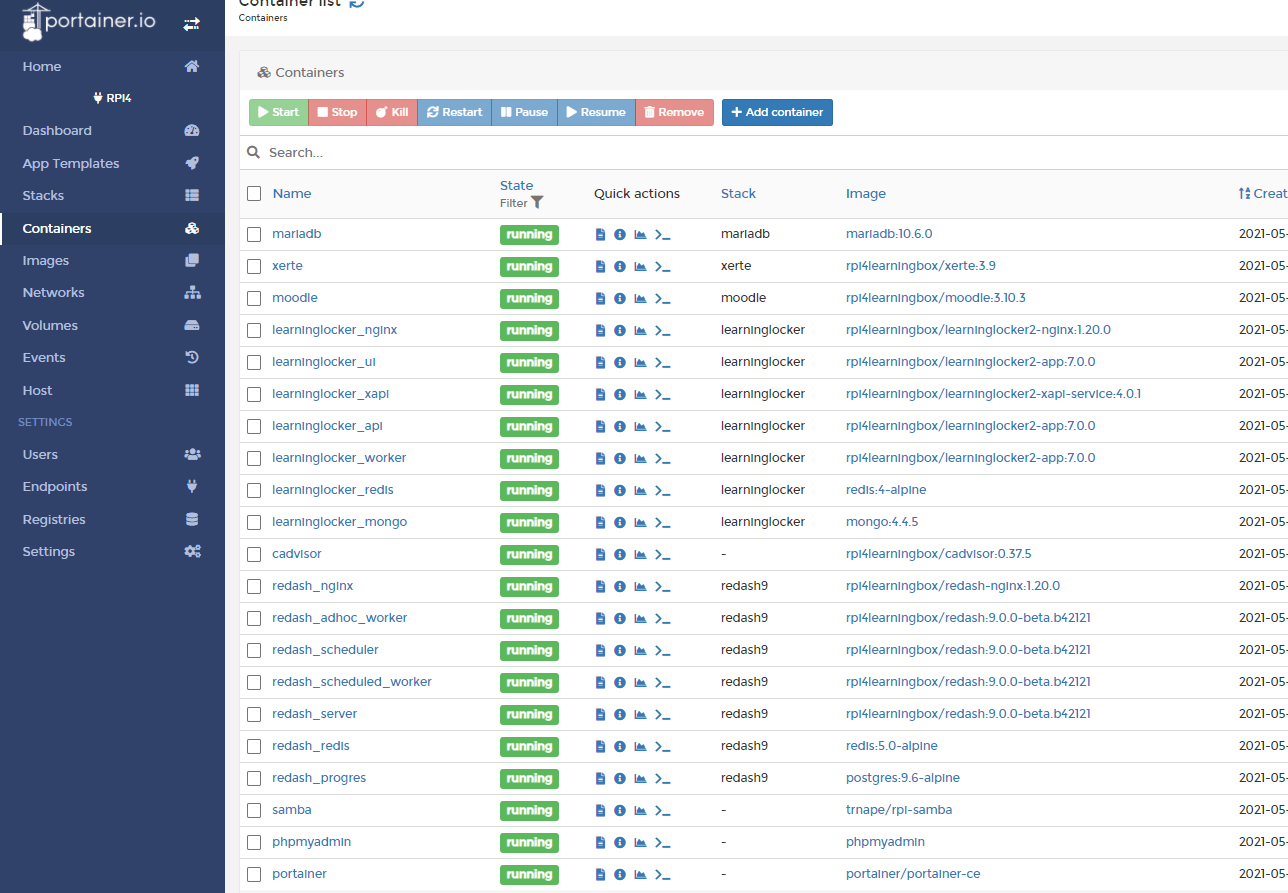

Het begon als een eenvoudige vraag: “kun je uitleggen hoe je Xerte binnen Docker kunt draaien?” en het eindigde (nou ja, gaat eindigen) in een toolset die bestaat uit Xerte (uiteraard), MariaDB (als database voor Xerte en Moodle), Tsugi (zodat Xerte ook LTI aankan), Moodle (als leeromgeving om de Xerte leerobjecten in te hangen), Learning Locker (LRS om de xAPI data […]

Mijn thuiswerkplek is na ruim een jaar thuiswerken eindelijk van een upgrade voorzien.

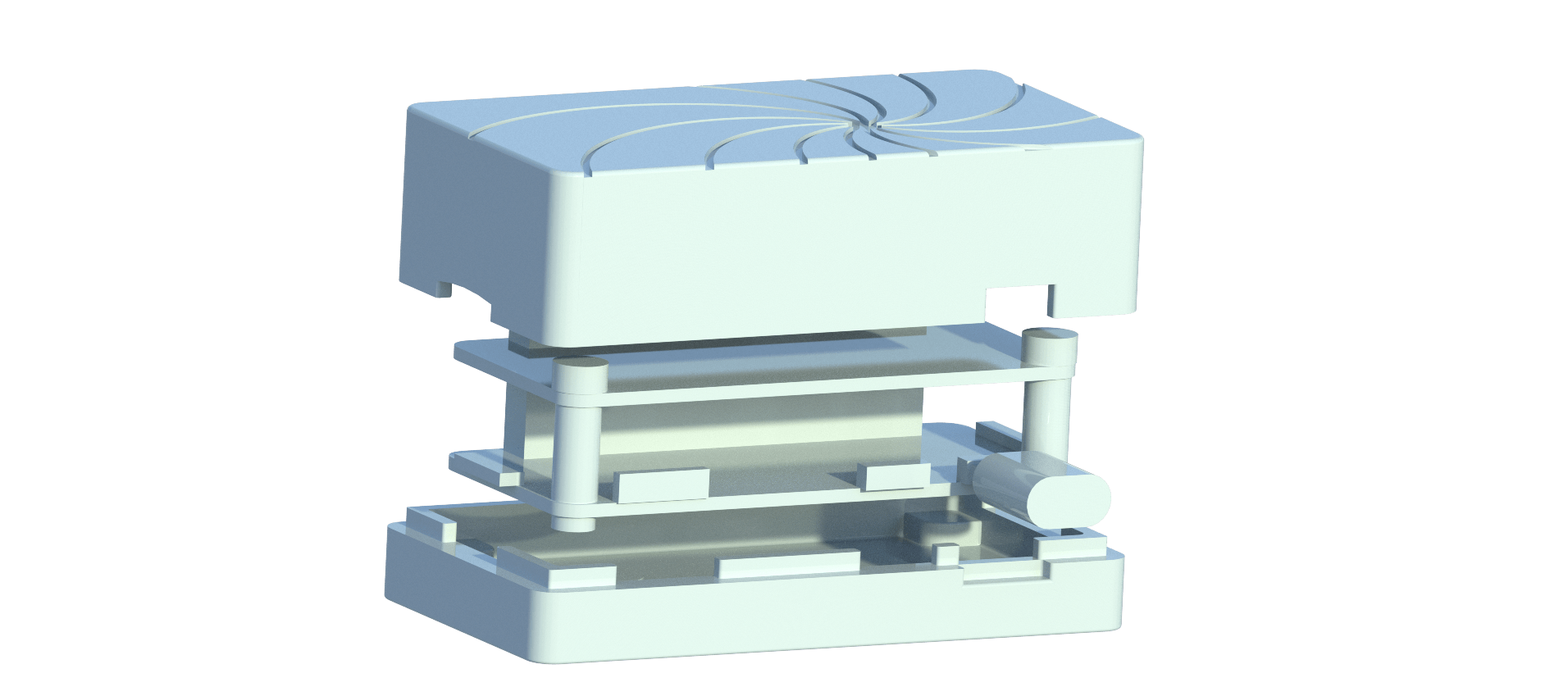

Ik vroeg Niek of hij een behuizing kon ontwerpen voor mijn Raspberry Pi Zero met Redbear IoT pHAT.

Voeg een patroon toe aan je 3D en maak hem printbaar en/of veel steviger.

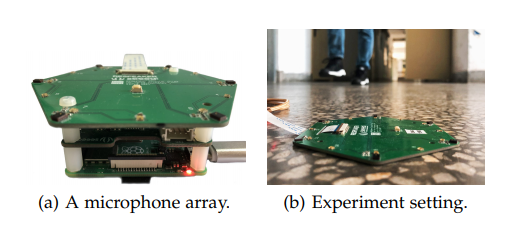

In de categorie “cool of toch ook wel een beetje eng?” valt dit paper over een onderzoeksproject genaamd “PURE: Passive mUlti-peRson idEntification via Deep Footstep Separation and Recognition”. De titel is (zoals het hoort) al tamelijk duidelijk: het is een systeem dat je voetstappen (hoe je loopt) gebruikt om je te herkennen. Hoe? Door te luisteren. Zowel door de lucht als […]

Klik om af te spelen ▶ Bekijk op YouTube EdX is niet de enige plek waar je (gratis of betaald) kunt leren over het gebruik van Machine Learning op kleine apparaten. Ook bij Coursera kun je nu terecht voor Introduction to Embedded Machine Learning. Ik ben pas in week 2 van de MOOC maar het is tot nu toe een degelijk […]

De broodbakmachine deed het niet meer. Weggooien of niet?

Kun je een Easy Bake Oven gebruiken als reflow-oven voor SMD?