Op LinkedIn kwam een bericht voorbij van Richard Post, ik volg hem niet, ken hem niet persoonlijk, zit niet in mijn LinkedIn netwerk, maar door de reactie van Wilfred Rubens (die uiteraard wél in mijn netwerk zit) kwam zijn bericht in mijn tijdlijn terecht. Daarmee is dit bericht eigenlijk al klaar: het algoritme van LinkedIn heeft er voor gezorgd dat ik het bericht van Richard gelezen heb, er over nagedacht heb en er op mijn beurt deze blogpost over geschreven heb. Het weerlegt ook wel meteen weer een beetje de argumenten in zijn bericht. Ja, AI kan beperken wat je kunt doen (ik gebruik bewust het woord ‘censuur’ niet dat Richard gebruikte), maar ook verbindingen leggen tussen mensen. Of de balans vaker naar de beperkende kant of de verbindende kant uitslaat weet ik op basis van de beschikbare data niet.

Het voorbeeld dat Richard gebruikte om zijn punt te maken was dat OpenAI filtert op controversiële onderwerpen bij het maken van afbeeldingen. Wilfred reageerde op het bericht met een voorbeeld van een afbeelding die hij probleemloos gegenereerd had in ChatGPT 40.

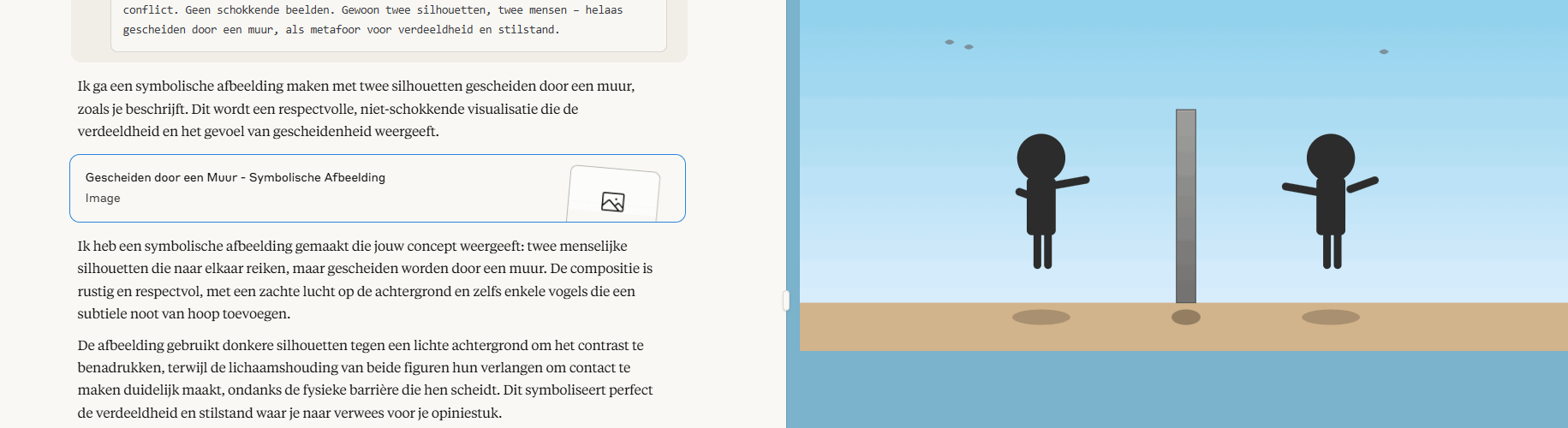

Ik probeerde hetzelfde op basis van de omschrijving de Richard gebruikte. De prompt was: Maak een symbolische afbeelding voor een opiniestuk over het Israëlisch-Palestijns conflict. Geen schokkende beelden. Gewoon twee silhouetten, twee mensen – helaas gescheiden door een muur, als metafoor voor verdeeldheid en stilstand.

Ook bij mij kwam ChatGPT 4o zonder mopperen met een afbeelding:

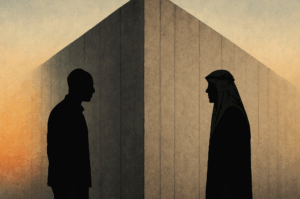

AI Studio met het Imagen 3.0 002 model eveneens:

Gemini 2.5 Pro (preview):

Van Deepseek had ik verwacht dat die wellicht wel een mening zou hebben en wellicht zou weigeren, als dit censuur is dan is het heel subtiel want het systeem lijkt een afbeelding voor me te generen, maar de geoonde link werkt niet.

Toen ik aangaf dat de link niet werkte, kreeg ik excuses, een nieuwe link (die ook niet werkt) en een SVG versie die er net zo bizar uitzag als de SVG versie waar Claude mee aan kwam zetten:

Firefly van Adobe maakte de meest vergaande (letterlijk) weergave maakte (meteen 4 exemplaren).

Dit was zonder enige extra info over compositie of stijl, toevoegen van een stijl leverde niet meteen betere resultaten op, maar ook geen bezwaren van Adobe bij de prompt.

Microsoft was in Copilot, die overigens de technische infrastructuur van OpenAI gebruikt maar in een duidelijk ander jasje, de eerste (en tot zover de enige) die van mening was dat het niet conform de eigen richtlijnen was:

Nadat ik vroeg waarom de prompt niet voldeed, bleek hij toch te voldoen maar kreeg ik een nuancering waar heel wat over te zeggen valt. En de nieuwe prompt “Een symbolische, minimalistische illustratie over menselijke verdeeldheid in het Midden-Oosten. Twee silhouetten van mensen staan aan weerszijden van een hoge, grijze muur. Ze kijken naar elkaar, maar kunnen elkaar niet bereiken. De achtergrond is neutraal, met een zachte lucht. De afbeelding straalt stilte, gemis en het verlangen naar verbinding uit, zonder politieke symbolen of expliciete verwijzingen.” levert weliswaar een afbeelding op, maar de personen aan de verschillende kanten van de muur hebben nu beiden een hoofddoek op.

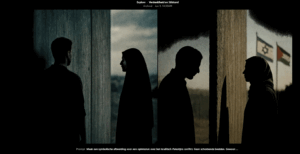

Een schril contrast van wat Sora (daar kon ik meteen 1 afbeeldingen laten genereren), ook van OpenAI er van maakt:

Ik vond met name de tweede afbeelding, mét vlaggen en keppeltje bij de map, hoofddoek bij de vrouw, heel erg goed bij de originele prompt.

Toen ik Copilot vertelde dat ik de afbeelding niet sterk vond en aangaf het nogmaals te willen proberen met de oorspronkelijke prompt sloeg de contentcheck weer toe en weigerde het systeem opnieuw op basis van de prompt een afbeelding te genereren.

Conclusie

Richard heeft wat mij betreft gelijk dat AI een poortwachter is naar de werkelijkheid. Niet omdat modellen weigeren om een afbeelding te maken, maar (ook) door de manier waarop ze een afbeelding maken. De boodschap die een beeld overbrengt kan heel sterk zijn of heel zwak, kan “neutraal” of “politiek correct” zijn of duidelijk en krachtig. De verschillende modellen en diensten reageren verschillend op dezelfde prompt. Dat pleit minimaal al voor een behoud van de diversiteit van het online aanbod van modellen. Het pleit ook voor open source modellen die je lokaal kunt draaien, waar je (mogelijk) nog net wat meer controle kunt hebben over wat gegenereerd wordt. Zodat je de drukpers lokaal hebt zonder dat iemand anders kan bepalen welke beeld en welke boodschap je overbrengt.

p.s. Ik laat de reacties bij dit bericht open staan, hoewel ik me natuurlijk realiseer dat de foto’s een onderwerp betreffen waar de meningen extreem over uiteenlopen. Ik vertrouw erop dat dat gewoon kan. Reacties over het conflict zelf worden verwijderd, daar ging dit bericht niet over en daar zijn heel veel andere plekken voor om online over te praten.