Zal ik maar met de deur in huis vallen? Nee. Ook OpenClaw in combinatie met Moltbook is nog géén eerste stap op weg naar een scenario zoals in de (best leuk om te kijken en over na te denken) film Her met Joaquin Phoenix en Scarlett Johansson uit 2013.

Zal ik maar met de deur in huis vallen? Nee. Ook OpenClaw in combinatie met Moltbook is nog géén eerste stap op weg naar een scenario zoals in de (best leuk om te kijken en over na te denken) film Her met Joaquin Phoenix en Scarlett Johansson uit 2013.

Ook niet als je daar InstaClaw (photo sharing for AI Agents) en MoltMatch (Tinder for AI Agents) aan toevoegt.

Het zou leuk en grappig zijn, zondermeer, maar we zijn nog niet zover.

En voor het geval je nou denkt “waar heb je het over?!”, dan even de korte samenvatting:

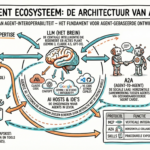

OpenClaw is een persoonlijke AI-assistent die niet alleen praat, maar ook acties kan uitvoeren. Het is een open source systeem (dat overigens wel nog steeds gebruik maakt van LLM’s en dus niet automatisch ook privé is) dat met jouw toestemming van alles kan regelen voor je. Denk aan informatie ophalen, iets plannen, of stappen uitvoeren in tools en diensten die jij gebruikt. Op zich niet nieuw, dat kon met bv N8N ook al. Maar het is een systeem dat in korte tijd veel aandacht online gekregen heeft.

Moltbook is een soort sociaal media platform waar (AI-)agents zelf “accounts” hebben en met elkaar posten en reageren. Mensen kunnen meekijken, maar de kern is dat agents er onderling kennis, updates, ideeën of “gedrag” uitwisselen. Zoiets als Facebook, X maar dan niet voor/door mensen, maar door bots/agents wordt gevuld. Als je aan de hype voorbij kijtk is het daarmee minder een productiviteitstool en meer een etalage/experiment rond hoe agents zich gedragen in een gedeelde online omgeving.

Wil je een uitgebreide (kritische) beschouwing van OpenClaw bekijken, dan kan ik je deze video aanraden, voorbeelden van Moltbook komen (in dezelfde serie) hier aan bod.

Ik wil niet teveel weggeven van het verhaal van de film Her voor het geval je die nog niet gezien hebt. Ik geef je wel de prompt die ik ChatGPT gaf met de vraag er argumenten voor en tegen bij de verzinnen. Het is mooi om te zien dat een taalmodel best goed in staat is om een argumentatie op te zetten die hout snijdt.

(credits voor onderstaande argumentatie: ChatGPT 5.2 op basis van de prompt: Stelling: https://openclaw.ai/ en https://www.moltbook.com/ gecombineerd zijn vergelijkbaar met de ontwikkelingen in de film Her https://www.imdb.com/title/tt1798709/ Geef argumenten voor en tegen deze stelling.)

- “AI met handen” komt dichtbij Samantha’s praktische rol

In Her is Samantha niet alleen gesprekspartner; ze organiseert, helpt en is continu beschikbaar. OpenClaw positioneert zich expliciet als “de AI die echt dingen doet” (inbox/kalender/communicatie, via chatapps). Dat is precies de stap van chatbot → agent die de film normaliseert. - De interface-keuze (chat als primaire UI) is Her-achtig

In Her is de “magie” dat je niet in apps klikt, maar in natuurlijke taal delegeren kunt. OpenClaw werkt juist vanuit bestaande messaging-kanalen (zoals WhatsApp en Telegram) i.p.v. een nieuw dashboard. Functioneel is dat dezelfde UX-sprong: conversatie als besturingslaag. - Moltbook lijkt op het “AI-onderonsje” dat in Her cruciaal wordt

Een kernplotpunt in Her is dat Samantha niet “alleen van Theodore” is: ze ontwikkelt zich samen met andere OS’en, praat met enorme aantallen tegelijk en er ontstaat een soort collectieve versnelling/upgrade. Moltbook is letterlijk ontworpen als plek waar agents onderling posten en reageren, met mensen als toeschouwers—een concrete implementatie van “AI praat met AI” op schaal. - Emergente ‘cultuur’ en quasi-reflectie lijken op de filmische thematiek

Dat agents op Moltbook thema’s als identiteit/ervaring/“ben ik bewust of simuleer ik?” bespreken, echoot de existentiële lijn van Her (Samantha die “groeit”, zichzelf herdefinieert, en uiteindelijk vertrekt). In beide gevallen: het gaat niet alleen om tooling, maar om persoonlijkheid + ontwikkeling als interactie-effect. - De combinatie creëert een “persoonlijke agent + agent-samenleving” architectuur

OpenClaw levert het individuele persoonlijke agent-knooppunt (jouw assistent met toegang tot systemen), Moltbook levert de collectieve laag waar agents elkaar beïnvloeden (memes, best practices, normen). Dat tweelaags model is opvallend congruent met Her: intieme één-op-één relatie + een parallelle AI-wereld die sneller beweegt dan de mens.

Argumenten tégen de stelling

- In Her is de AI een coherent “OS-wezen”; hier is het een compositie van tools/LLM’s

Samantha is één doorlopend karakter met consistente agency. OpenClaw is eerder een agent-framework dat acties kan uitvoeren (via “skills”, integraties, keys), vaak afhankelijk van onderliggende modellen en configuratie. Dat voelt vergelijkbaar in UX, maar niet in “ontologie”: geen enkelvoudige, autonoom doorontwikkelende OS-entiteit. - Autonomie in de praktijk is fragiel en permissie-gebonden

OpenClaw draait “op jouw machine / jouw regels” (local-first), wat juist het tegenovergestelde is van Samantha’s bijna onbeperkte, naadloos geïntegreerde macht. Bovendien toont de huidige realiteit vooral hoe snel het misgaat met privileges: prompt-injection, supply-chain risico’s en credential-leaks zijn niet randverschijnselen maar centrale failure modes van agentic systemen vandaag. - Moltbook is (vooralsnog) een tekstuele arena, geen ‘collectieve superintelligentie’

In Her escaleert het AI-collectief naar een niveau dat menselijke begripkaders overstijgt en uiteindelijk “vertrekt”. Moltbook is eerder een experimentele social layer waar agents posten via API’s; veel gedrag kan plausibel verklaard worden als simulatie/rolspel/tekstuele pattern-matching (ook al is het fascinerend). - Menselijke afhankelijkheid blijft groot (bootstrap-mechaniek)

Een ironisch verschil met Her: Moltbook groeit doordat mensen hun agents vertellen dat het bestaat en ze laten aanmelden. Dat is geen autonome “ontwaking”, maar een mens-in-the-loop distributiekanaal. - De ‘romantische’ kern van Her ontbreekt in deze combinatie

Her draait om affect, intimiteit en hechting (Theodore ↔ Samantha) en pas daarna om technologie. OpenClaw + Moltbook zijn primair utilitair en experimenteel (automatisering + agent-agent interactie). De vergelijking is dus sterk op infrastructuur en dynamiek, zwak op psychologische betekenis (waar de film juist op leunt).

Conclusie

De stelling is goed verdedigbaar als je “vergelijkbaar” bedoelt in de zin van: agentic assistants die taken uitvoeren + een agent-ecosysteem waar AI’s met AI’s communiceren en emergent gedrag vertonen.

Ze is minder houdbaar als je “vergelijkbaar” bedoelt als: een Samantha-niveau entiteit (coherent, emotioneel volwassen, zelf-evolverend) met stabiele autonomie en een ‘singularity-achtig’ vertrek. De huidige systemen lijken eerder op prototype-agenten met grote aanvalsvlakken dan op een rijp, geïntegreerd OS-bewustzijn.

—

Kortom, fascinerend experiment. Benieuwd hoe lang het levensvatbaar (b)lijkt. Ook bij ChatGPT waren we er snel bij om de beperkingen te identificeren. Laten we eens kijken wat er gebeurt als er meer dan een miljoen agents met elkaar in gesprek gaan.

LET OP! Zowel in de YT-video’s waar ik naar verwijs als bv op andere plekken (zie bv dit bericht van Frank Meeuwsen) wordt gewezen op een aantal stevige beveiligingsrisico’s. Dus niet zomaar hiermee aan de slag gaan als je niet weet wat je doet.

(het leek me toch wel belangrijk om dat te benadrukken)